6、7年没有调研现在流程的工具了,调研并记录一下。 Apache SeaTunnel Apache SeaTunnel 是一个开源的、高性能的分布式数据集成平台,专为海量数据的批处理、流处理和实时数据同步而设计。它能够高效地完成数据抽取、转换与加载,支持在数十种异构数据源之间进行无缝传输,广泛用于数据仓库入湖、实时数仓构建、数据迁移和备份等场景。 Trino Trino 是一个“不带存储,只动脑子”的超级联邦查询引擎。它自己不存数据,但可以用一条 SQL,同时去查询你存放在 MySQL、Elasticsearch、…

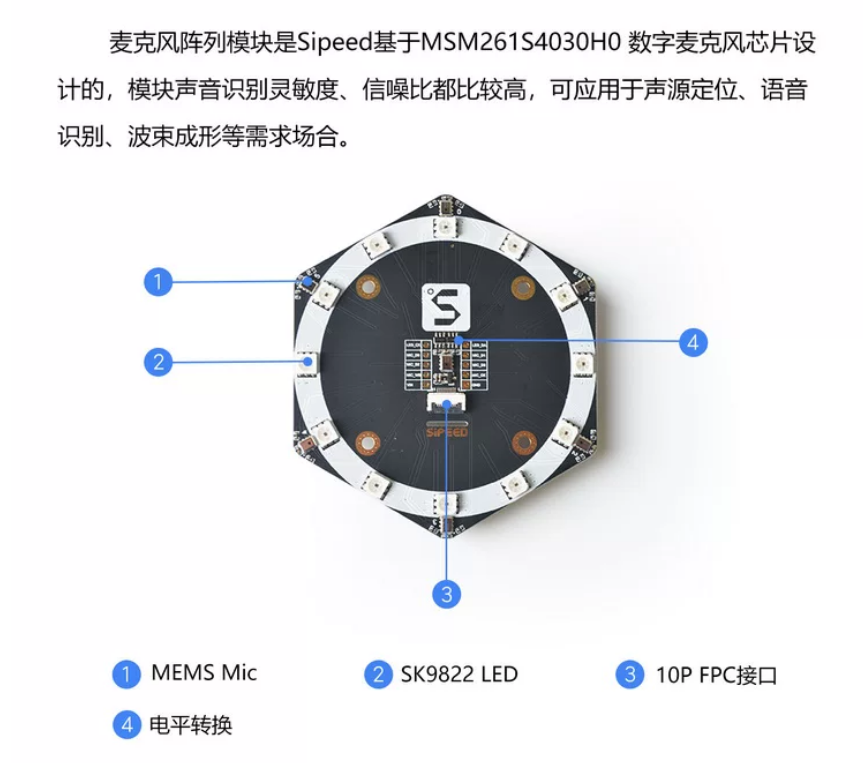

参考文件:麦克风阵列 UAC 驱动板 MA-USB8(使用指南) - Sipeed Wiki 参考文件:MaixCAM MaixPy 快速开始 - MaixPy 🎵 MaixPy 音频模块 API (maix.audio) 这个API为你提供了在MaixPy环境下处理音频文件的基础工具,目前主要包括音频格式常量和文件读写类。 音频格式常量 (Format) maix.audio 模块通过一个 Format 枚举定义了一套音频采样格式,用来统一处理不同的数据类型和字节序。文档里还提供了一个 fmt_b…

你想在 Win10 专业版 离线部署一个可用于开发和调试的 .NET 6.0 环境,并且希望流程尽量简单。这里我给你整理一个 最精简、离线可行方案: 1️⃣ 准备工作(在线环境下载所需离线包) 2️⃣ 离线安装 .NET 6 SDK 3️⃣ 配置开发环境 你想离线迁移或安装 VS Code 的 @id:ms-dotnettools.csdevkit 插件(C# 开发工具集),我给你整理两种完全离线可行方案: 1️&#x…

在智能工厂软件团队中,我们经常遇到一个问题:产品功能越来越丰富,但市场反应不明朗,销售难以落地,客户使用率低。为了解决这一问题,我们设计了一套三问法管理机制,帮助团队从三个视角(销售、营销、客户)验证产品价值和商业落地能力。 目标明确:三个验证维度 在实施三问法之前,我们需要明确目标,这套机制只服务于三个核心问题: 销售三问(Sales)——看“钱能不能进来” 销售是检验商业可行性的第一环节。针对销售,我们提出三个核心问题: 1. 本周最有可能成交的项目是哪个?当前卡在哪一步? 销售需给出: 2. 客户愿意为哪一个…

33岁男性程序员12天前觉得腰不舒服,估计是最近一个月开始练八段锦,练习下腰所致。0~6天都在办公,越来越不舒服。6~9天出门旅游感觉腰已经好了。第10天背了比较沉的双肩包走了2个小时,腰就恶化到了第6天的水平。第10~12天在上班,感觉不舒服。最近几天早上起来也不舒服,没有刺痛、麻木。感觉不舒服的在左侧后腰。第15天腰肌略好转,随由GPT大模型出了训练计划,开始康复训练。 🧠 腰部康复训练总表 每天16:00~19:00 花费25分钟完成本训练。久坐办公每30分钟必须起身2~3分钟。坐久后做1~2…

下文由GPT总结得出 在使用 Docker 部署如 Nexus 这类服务时,经常会遇到一个看似简单但非常容易踩坑的问题:文件权限 UID 不一致导致的 AccessDeniedException。本文结合实际案例,系统梳理 Linux UID 机制、Docker 容器用户模型,以及 Nexus 的权限设计逻辑。 一、Linux 权限的本质:只认 UID,不认用户名 Linux 文件系统权限模型的核心是: 一切权限判断基于 UID(数字),而不是用户名 例如: UID 含义 0 root 1000+ 普通用户 因此:…

直接说结论:你这个场景(多 iframe + 工业系统 + 并发调用)——必须用 postMessage + MessageChannel + Promise RPC,这是浏览器内通信的“准工业级方案”。 我给你一个可落地的完整设计,重点解决: 一、整体架构设计 1)通信拓扑(推荐) 👉 核心思想: 2)通信机制 建立连接(一次性) 后续通信 二、核心能力设计 你需要实现这几个模块: 模块 作用 Connection Manager 管理 iframe 连接 RPC Core 请求/响应机制 Ser…

可以用,而且强烈建议你用 tool calling(函数调用)来做这件事。不然你会遇到典型问题:HTML输出不完整、格式漂移、混入解释文本、不可解析。 下面直接给你一个工程化结论 + 落地方案。 一、结论(你这个场景是否适合 Tool Call) 你的需求: “让 LLM 根据需求生成 HTML5 页面” 👉 非常适合用 tool call,原因: ✔ 优势 二、推荐设计(核心) ✅ 定义一个工具:generate_html 三、调用流程(标准架构) 四、Python实现…